7 cách tội phạm mạng sử dụng AI để lừa đảo tình cảm

Các ứng dụng hẹn hò trực tuyến luôn là điểm nóng cho những vụ lừa đảo lãng mạn. Tội phạm mạng luôn cố gắng đánh cắp tiền, thông tin cá nhân và ảnh khiêu dâm. Bạn sẽ tìm thấy hồ sơ giả mạo của họ ở khắp mọi nơi.

Và với sự gia tăng nhanh chóng của các công cụ trí tuệ nhân tạo, các vụ lừa đảo lãng mạn ngày càng trở nên dễ thực hiện hơn. Họ hạ thấp các rào cản gia nhập. Dưới đây là bảy cách phổ biến mà những kẻ lừa đảo lãng mạn khai thác AI—cùng với cách bạn có thể tự bảo vệ mình.

Mục Lục

1. Gửi hàng loạt email do AI tạo ra

Thư rác ngày càng khó lọc hơn. Những kẻ lừa đảo lãng mạn lạm dụng các công cụ AI tổng quát để viết những thông điệp thuyết phục, gây hiểu lầm và tạo nhiều tài khoản trong vòng vài giờ. Họ tiếp cận hàng trăm gần như ngay lập tức.

Bạn sẽ thấy các thư rác do AI tạo ra trên nhiều nền tảng khác nhau, không chỉ trong hộp thư đến email của bạn. Lấy nhầm số lừa đảo làm ví dụ. Kẻ lừa đảo gửi hàng loạt ảnh tự sướng dễ thương hoặc ảnh khêu gợi. Và nếu bất cứ ai phản hồi, họ sẽ coi đó là một sai lầm vô tội.

Sau khi ai đó bắt máy, họ sẽ được chuyển sang một nền tảng nhắn tin khác (ví dụ: WhatsApp hoặc Telegram). Hầu hết các kế hoạch chạy trong nhiều tuần. Những kẻ lừa đảo dần dần xây dựng lòng tin trước khi yêu cầu các mục tiêu tham gia các kế hoạch đầu tư, gánh vác các hóa đơn của họ hoặc trả tiền cho các chuyến đi.

Giữ an toàn bằng cách tránh hoàn toàn thư rác. Hạn chế tương tác với người lạ, bất kể họ trông như thế nào hoặc họ cung cấp những gì.

2. Trả lời nhanh chóng nhiều cuộc trò chuyện hơn

Bot đang lan nhanh như cháy rừng trên mạng. Imperva báo cáo rằng các bot xấu chiếm 30% lưu lượng truy cập web tự động vào năm 2022. Bạn sẽ tìm thấy một bot trong vòng vài giây sau khi vuốt qua các kết quả trùng khớp trên Tinder.

Một trong những lý do khiến số lượng bot tăng đột biến này là sự gia tăng nhanh chóng của các công cụ AI tổng quát. Họ tạo ra các bot với số lượng lớn. Chỉ cần nhập đúng dấu nhắc và công cụ của bạn sẽ hiển thị một đoạn mã hoàn chỉnh, hiệu quả để tạo bot.

Biết khi nào bạn đang nói chuyện với bot. Mặc dù AI sử dụng giọng điệu trò chuyện tự nhiên, nhưng cuộc đối thoại của nó vẫn có vẻ đơn điệu và khó xử. Xét cho cùng, chatbot chỉ đơn thuần tuân theo các mẫu. Nó có thể tạo ra những câu trả lời tương tự cho những câu hỏi, câu nói và yêu cầu khác nhau.

3. Tạo nhiều danh tính từ hình ảnh bị đánh cắp

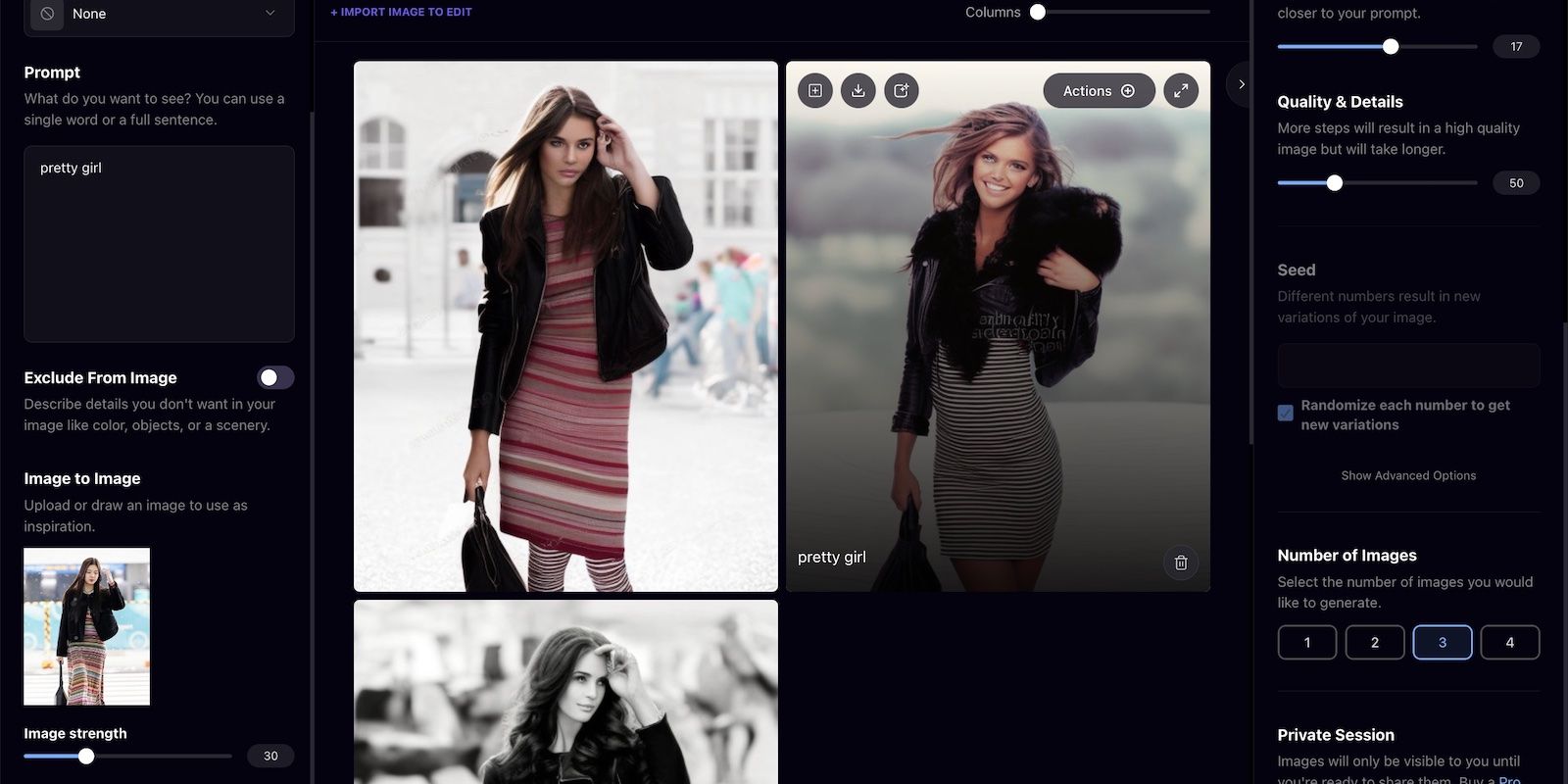

Trình tạo nghệ thuật AI thao tác hình ảnh. Lấy cuộc biểu tình dưới đây làm ví dụ. Chúng tôi đã cung cấp cho Playground AI một bức ảnh chân thực của một ca sĩ nổi tiếng—nền tảng này tạo ra ba biến thể trong vòng vài giây.

Vâng, họ có sai sót. Nhưng lưu ý rằng chúng tôi đã sử dụng một công cụ miễn phí chạy mô hình chuyển văn bản thành hình ảnh đã lỗi thời. Những kẻ lừa đảo tạo ra đầu ra thực tế hơn với các bước lặp tinh vi. Họ có thể nhanh chóng kết xuất hàng trăm bức ảnh đã được chỉnh sửa, tùy chỉnh chỉ từ một vài mẫu.

Thật không may, hình ảnh AI rất khó phát hiện. Đặt cược tốt nhất của bạn là thực hiện tìm kiếm hình ảnh ngược và sàng lọc các kết quả có liên quan.

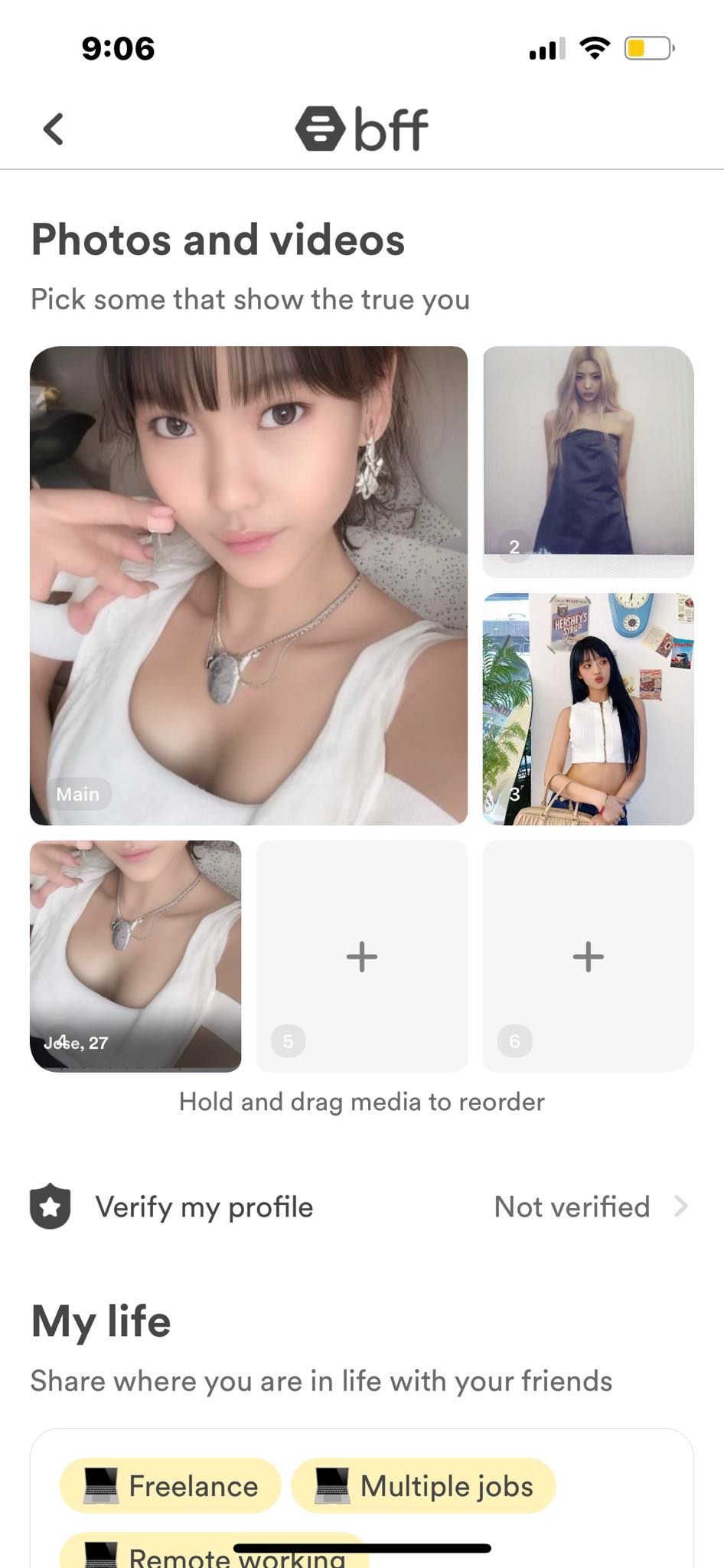

4. Xây dựng hồ sơ trông giống thật

Bot tiếp cận nạn nhân hàng loạt. Vì vậy, những kẻ lừa đảo lãng mạn thích một kế hoạch được nhắm mục tiêu chỉ tạo một hoặc hai hồ sơ trông giống thật. Họ sẽ sử dụng AI để có vẻ thuyết phục. Các công cụ AI sáng tạo có thể tạo ra các mô tả trông chân thực nghe có vẻ tự nhiên và chân thực; ngữ pháp xấu sẽ không còn là một vấn đề.

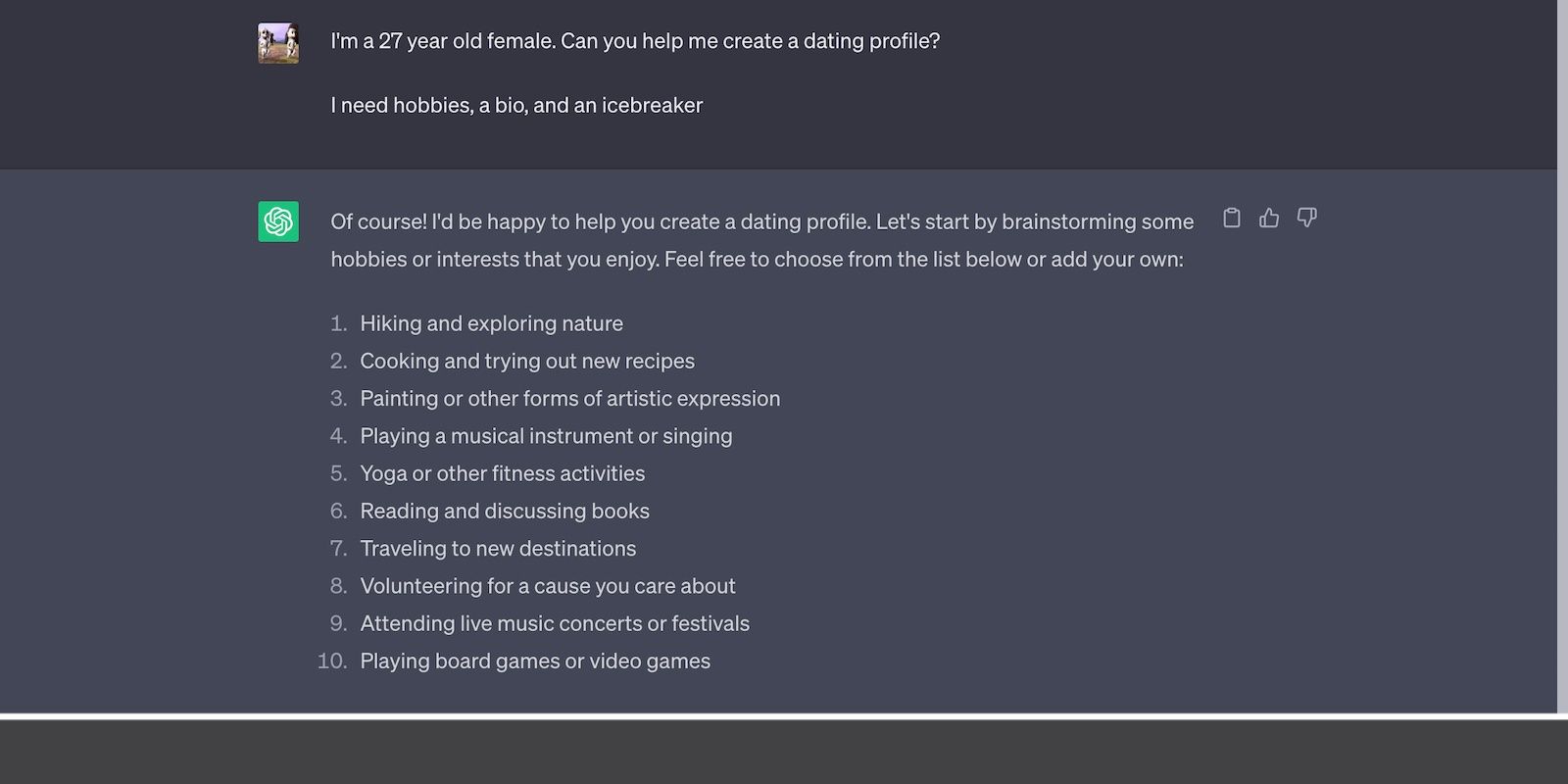

Đây là ChatGPT gợi ý một số sở thích để liệt kê trên hồ sơ hẹn hò.

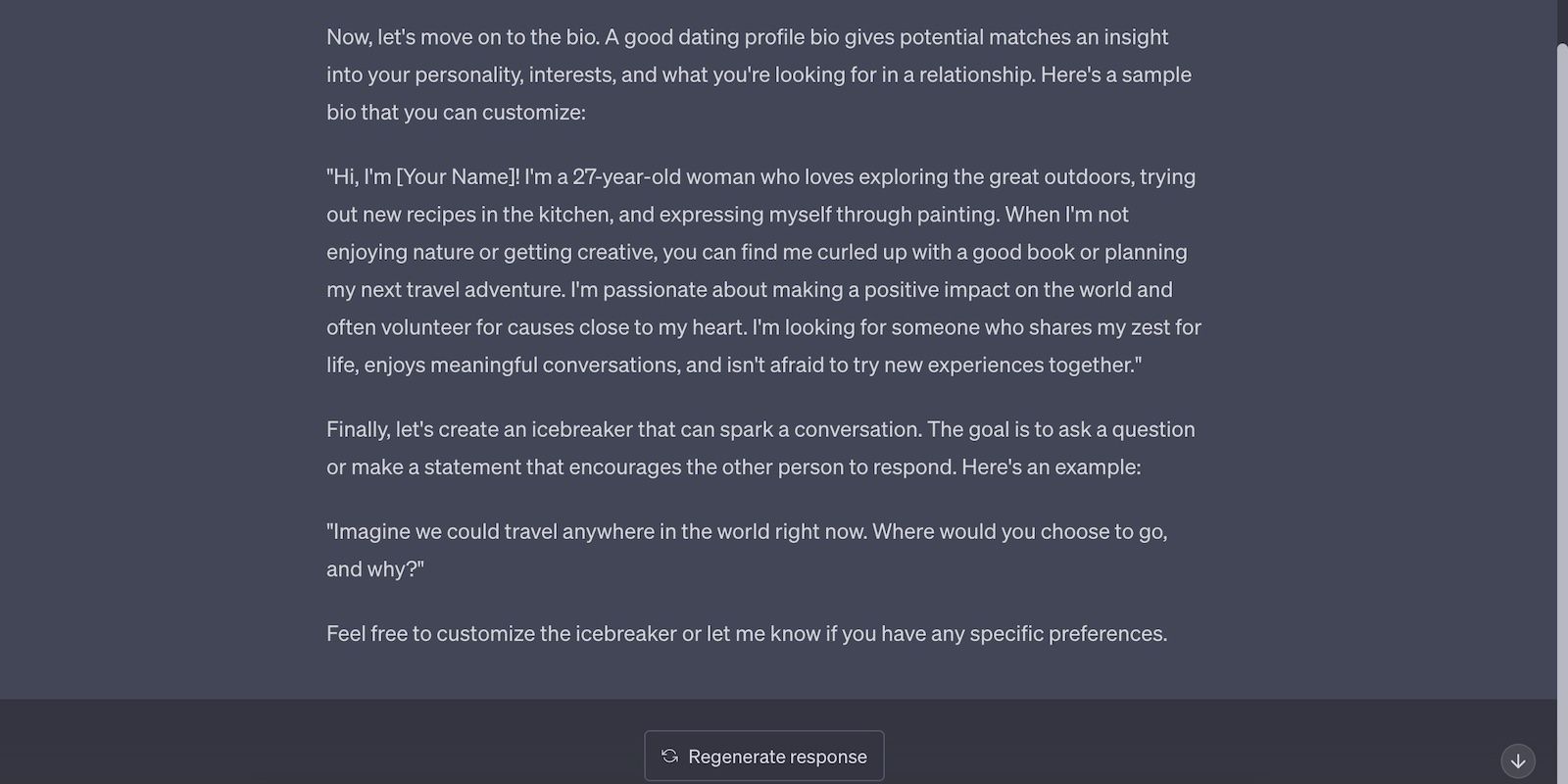

Và đây là ChatGPT viết toàn bộ tiểu sử cho hồ sơ hẹn hò của bạn.

Vì quá trình này tiêu tốn rất nhiều thời gian nên nó cũng đòi hỏi một khoản tiền lớn hơn. Vì vậy, những kẻ lừa đảo có xu hướng yêu cầu nhiều hơn. Sau khi có được lòng tin của bạn, họ sẽ yêu cầu giúp đỡ về nhiều “vấn đề” khác nhau, chẳng hạn như hóa đơn bệnh viện, thanh toán khoản vay hoặc học phí. Một số thậm chí sẽ yêu cầu đến thăm bạn nếu bạn nhận vé của họ.

Những tội phạm mạng này có kỹ năng thao túng nạn nhân. Chiến thuật tốt nhất là tránh tương tác với họ ngay từ đầu. Đừng để họ nói bất cứ điều gì. Nếu không, bạn có thể dần dần rơi vào các phương pháp đánh lừa và châm ngòi của họ.

5. Khai thác công nghệ Deepfake để tống tiền tình dục

Các công cụ deepfake tiên tiến AI với tốc độ nhanh đáng báo động. Các công nghệ mới giúp giảm các khuyết điểm nhỏ trong video deepfake, chẳng hạn như nhấp nháy không tự nhiên, tông màu da không đồng đều, âm thanh bị méo và các yếu tố không nhất quán.

Thật không may, những lỗi này cũng đóng vai trò là dấu hiệu đỏ. Việc cho phép người dùng xóa chúng khiến việc phân biệt giữa video hợp pháp và video deepfake trở nên khó khăn hơn.

Bloomberg cho thấy cách bất kỳ ai có kiến thức công nghệ cơ bản đều có thể điều khiển giọng nói và hình ảnh của mình để tái tạo những người khác.

Ngoài việc tạo hồ sơ hẹn hò thực tế, những kẻ lừa đảo còn khai thác các công cụ deepfake để tống tiền tình dục. Họ pha trộn các bức ảnh và video công khai với nội dung khiêu dâm. Sau khi thao túng nội dung bất hợp pháp, chúng sẽ tống tiền nạn nhân và đòi tiền, dữ liệu cá nhân hoặc các đặc ân tình dục.

Đừng hang động nếu bạn nhận được mục tiêu. Hãy gọi 1-800-CALL-FBI, gửi thông báo cho FBI hoặc đến văn phòng FBI tại địa phương nếu bạn rơi vào tình huống này.

6. Tích hợp các mô hình AI với các hệ thống hack Brute-Force

Mặc dù các mô hình ngôn ngữ nguồn mở hỗ trợ một số tiến bộ của AI, nhưng chúng cũng dễ bị khai thác. Tội phạm sẽ lợi dụng bất cứ điều gì. Bạn không thể mong đợi họ bỏ qua thuật toán đằng sau các mô hình ngôn ngữ rất phức tạp như LLaMA và OpenAssistant.

Trong các vụ lừa đảo lãng mạn, tin tặc thường tích hợp các mô hình ngôn ngữ với việc bẻ khóa mật khẩu. Khả năng học máy và NLP của AI cho phép các hệ thống hack mạnh tạo ra các tổ hợp mật khẩu một cách nhanh chóng và hiệu quả. Họ thậm chí có thể đưa ra dự đoán sáng suốt nếu được cung cấp đủ ngữ cảnh.

Bạn không có quyền kiểm soát những gì kẻ lừa đảo làm. Để bảo vệ tài khoản của bạn, hãy đảm bảo bạn tạo một mật khẩu thực sự an toàn bao gồm các ký tự đặc biệt, tổ hợp chữ và số và hơn 14 ký tự.

7. Bắt chước người thật bằng nhân bản giọng nói

Máy tạo giọng nói AI bắt đầu như một món đồ chơi thú vị. Người dùng sẽ biến các bản nhạc mẫu của nghệ sĩ yêu thích của họ thành bản cover hoặc thậm chí là bài hát mới. Lấy Heart on My Sleeve làm ví dụ. Người dùng TikTok Ghostwriter977 đã tạo một bài hát siêu thực bắt chước Drake và The Weeknd, mặc dù không nghệ sĩ nào hát nó.

Bất chấp những trò đùa và meme xung quanh nó, việc tổng hợp giọng nói là rất nguy hiểm. Nó cho phép bọn tội phạm thực hiện các cuộc tấn công tinh vi. Chẳng hạn, những kẻ lừa đảo lãng mạn khai thác các công cụ nhân bản giọng nói để gọi cho các mục tiêu và để lại các bản ghi âm lừa đảo. Những nạn nhân không quen với việc tổng hợp giọng nói sẽ không nhận thấy điều gì bất thường.

Bảo vệ bạn khỏi các trò gian lận sao chép giọng nói AI bằng cách nghiên cứu cách tổng hợp âm thanh đầu ra. Khám phá những máy phát điện này. Chúng chỉ tạo ra các bản sao gần giống hệt nhau—bạn vẫn sẽ phát hiện ra một số điểm không hoàn hảo và không nhất quán.

Bảo vệ bản thân trước những kẻ lừa đảo hẹn hò AI

Khi các công cụ AI ngày càng phát triển, những kẻ lừa đảo lãng mạn sẽ phát triển những cách mới để khai thác chúng. Các nhà phát triển không thể ngăn chặn những tên tội phạm này. Đóng vai trò chủ động trong việc chống lại tội phạm mạng thay vì chỉ tin tưởng rằng các hạn chế bảo mật có tác dụng. Bạn vẫn có thể sử dụng các ứng dụng hẹn hò. Nhưng hãy chắc chắn rằng bạn biết người ở phía bên kia màn hình trước khi tương tác với họ.

Và coi chừng các chương trình hỗ trợ AI khác. Bên cạnh những trò lừa đảo lãng mạn, bọn tội phạm sử dụng AI để đánh cắp danh tính, tống tiền trên mạng, tống tiền, tấn công ransomware và hack vũ phu. Tìm hiểu để chống lại những mối đe dọa là tốt.